Моделирование нейронных сетей для прогнозирования стоимости недвижимости

2. Вычислить реакцию сети y(i).

3. Сравнить полученную реакцию y(i) с требуемой y*(i) и определить ошибку y*(i) – y(i).

4. Скорректировать веса так, чтобы ошибка была минимальной.

5. Шаги 1-4 повторить для всего множества обучающих пар (x(i), y*(i)) ![]() до тех пор, пока на заданном множестве ошибка не достигнет требуемой ве

до тех пор, пока на заданном множестве ошибка не достигнет требуемой ве

личины.

Таким образом, при обучении сети подача входного сига и вычисление реакции соответствует прямому проходу сигнала от входного слоя к выходному, а вычисление ошибки и коррекция выходных параметров - обратному, когда сигнал ошибки распространяется по сети от ее выхода ко входу. При обратном проходе осуществляется послойная коррекция весов, начиная с выходного слоя. Если коррекция весов выходного слоя осуществляется с мощью модифицированного «дельта-правила» сравнительно просто, поскольку требуемые значения выходных сигналов известны, то коррекция весов скрытых слоев происходит несколько сложнее, поскольку для них неизвестны требуемые выходные сигналы.

Алгоритм обратного распространения применим к сетям с любым количеством слоев: как к сетям прямого распространения, так и к содержащим обратные связи.

4.4 Модель сети типа радиально-базисной функции

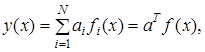

Радиально-базисные сети были предложены для аппроксимации функций многих переменных. C помощью радиально-базисных функций можно сколь угодно точно аппроксимировать заданную функцию. Как и многослойный персептрон, радиально-базисная сеть является универсальным аппроксиматором. Математическую основу РБ-сети составляет метод потенциальных функций, разработанный М.А. Айзерманом, Э.М. Браверианом и Л.И. Розоноэром, позволяющий представить некоторую функцию у(х) в виде суперпозиции потенциальных или базисных функций fi(x)

(4.9)

(4.9)

где ai(t) = (a1, a2, ., aN)T – вектор подлежащих определению параметров; f(x) = (f1(x), f2(x), ., fN(x))T – вектор базисных функций.

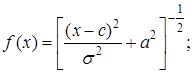

В РБС в качестве базисных выбираются некоторые функции расстояния между векторами

![]() (4.10)

(4.10)

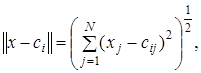

Векторы сi называют центрами базисных функций. Функции fi(x) выбираются неотрицательными и возрастающими при увеличении ![]() . В качестве меры близости векторов х и ci выбираются обычно либо евклидова метрика

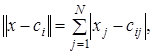

. В качестве меры близости векторов х и ci выбираются обычно либо евклидова метрика  либо манхэттенская

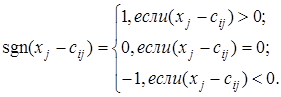

либо манхэттенская  где

где ![]()

(4.11)

(4.11)

Радиально-базисные сети обладают большой скоростью обучения. При их обучении не возникает проблем с «застреванием» в локальных минимумах. Однако в связи с тем, что при выполнении непосредственно классификации проводятся довольно сложные вычисления, возрастает время получения результата.

4.4.1 Структура РБФ

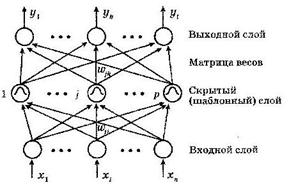

Структура РБФ соответствует сети прямого распространения первого порядка (рисунок 4.10).

Информация об образах передается с входного слоя на скрытый, являющийся шаблонным и содержащий ρ нейронов. Каждый нейрон шаблонного слоя, получая полную информацию о входных сигналах х, вычисляет функцию

![]() (4.12)

(4.12)

где вектор входных сигналов ![]() ; ci - вектор центров

; ci - вектор центров ![]() ; R – весовая матрица.

; R – весовая матрица.

Рисунок 4.10 – Структура радиально-базисной сети

Особенностью данных сетей является наличие радиально-симметричного шаблонного слоя, в котором анализируется расстояние ![]() между входным вектором и центром, представленным в виде вектора во входном пространстве. Вектор центров определяется по обучающей выборке и сохраняется в пространстве весов от входного слоя к слою шаблонов.

между входным вектором и центром, представленным в виде вектора во входном пространстве. Вектор центров определяется по обучающей выборке и сохраняется в пространстве весов от входного слоя к слою шаблонов.

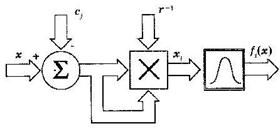

Рассмотрим нейрон шаблонного слоя сети. На рисунке 4.11 представлен i-й нейрон шаблонного слоя РБ-сети. Обработку поступающей на него информации условно можно разделить на два этапа: на первом вычисляется расстояние между предъявленным образом х и вектором центров сi с учетом выбранной метрики и нормы матрицы R, на втором это расстояние преобразуется нелинейной активационной функцией f(x). Двойные стрелки на рисунке обозначают векторные сигналы, а тройные - матричный сигнал.

Рисунок 4.11 – Нейрон шаблонного слоя РБС

В качестве функции преобразования ![]() наиболее часто выбираются следующие:

наиболее часто выбираются следующие:

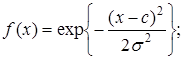

– гауссова функция

(4.13)

(4.13)

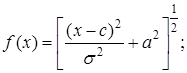

– мультиквадратичная функция

(4.14)

(4.14)

– обратная мультиквадратичная функция

(4.15)

(4.15)

– сплайн-функция

![]() (4.16)

(4.16)

– функция Коши

![]() (4.17)

(4.17)

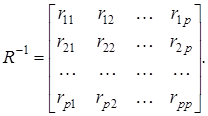

Норма матрицы R-1 определяет положение осей в пространстве. В общем виде матрица R-1 может быть представлена следующим образом:

(4.18)

(4.18)

Весовую матрицу R1 также называют обратной ковариационной матрицей. Элементы этой матрицы равны

![]()

![]() (4.19)

(4.19)

Здесь ![]() – некоторые управляемые параметры.

– некоторые управляемые параметры.

Часто матрица R-1 выбирается диагональной, т.е. ![]() для i≠j, и более того, принимают

для i≠j, и более того, принимают ![]()

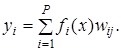

Величина сигнала j-го нейрона выходного слоя уj зависит от того, насколько близок предъявляемый входной сигнал х запомненному этим нейроном центру сj. Значение уj определяется как взвешенная сумма функций (4.9), т.е.

(4.20)

(4.20)

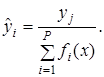

Обычно выходными сигналами сети являются нормализованные значения ![]() вычисленные по формуле

вычисленные по формуле

(4.21)

(4.21)

4.4.2 Обучение РБФ

РБ-сеть характеризуют три типа параметров:

– линейные весовые параметры выходного слоя wij входят в описание сети линейно);

– центры ci – нелинейные (входят в описание нелинейно) параметры скрытого слоя;

– отклонения (радиусы базисных функций) σij – нелинейные параметры скрытого слоя.

Другие рефераты на тему «Экономико-математическое моделирование»:

Поиск рефератов

Последние рефераты раздела

- Выборочные исследования в эконометрике

- Временные характеристики и функция времени. Графическое представление частотных характеристик

- Автоматизированный априорный анализ статистической совокупности в среде MS Excel

- Биматричные игры. Поиск равновесных ситуаций

- Анализ рядов распределения

- Анализ состояния финансовых рынков на основе методов нелинейной динамики

- Безработица - основные определения и измерение. Потоки, запасы, утечки, инъекции в модели